Esta será la tercera parte de una serie de artículos breves sobre el tema, que estará dividida en 6 partes:

- La gran nube infernal: el coste ambiental injustificado

- El ‘pecado original’: la piratería corporativa disfrazada de innovación

- La falacia de lo fiable: alucinaciones, sesgos y la muerte del hecho

- El efecto escaparate: si tu artículo está ilustrado por IAG, no me fío

- La promesa vacía: no lo llames ‘productividad’, llámalo ‘liquidación’

- La gran mierdificación: envenenando internet y nuestro cerebro

La falacia de lo fiable: alucinaciones, sesgos y la muerte del hecho

Seamos claros. El término mismo de “inteligencia artificial” es un oxímoron. Por muchas piruetas semánticas que le demos al término “inteligencia” —y se le pueden dar muchísimas, os lo aseguro—, lo que hace ChatGPT o MidJourney está muy lejos de ser inteligente.

Las IAG no comprenden la realidad. Calculan probabilidades en función de unos parámetros, siguiendo unos algoritmos variables. Esto hace que sean susceptibles de arrastrar los errores y sesgos de aquellos autores que escribieron o diseñaron el material original con el que la IAG fue alimentada, sumados al sesgo de selección que se hiciera en la propia alimentación del modelo, y sumado también a los sesgos que los programadores pudiesen introducir en el modelo.

ChatGPT tiende a dar siempre la razón —incluso a una persona equivocada—, salvo, que yo sepa, en cinco ocasiones: (1) que el error sea muy gravemente manifiesto —nunca te defenderá que la tierra es plana—, (2) que la postura sea extraordinariamente radical —nunca te defenderá una postura pro-esclavitud—, (3) que ahonde en dogmas profundamente arraigados y potencialmente conflictivos —nunca te negará la existencia del dios bíblico—, (4) que vayan contra su propia programación —no te va a generar un contenido prohibido por sus políticas de uso, como un relato erótico explícito, si no tiene permitido hacerlo— o (5) que vaya contra los intereses empresariales —si le planteas la idea del decrecentismo como solución al cambio climático o el apagado de los centros de datos como medida de mitigación, te lo negará y abogará por el tecnooptimismo, en un escenario donde su empresa, sus centros de datos, y por extensión, el propio modelo, estarán operativos—.

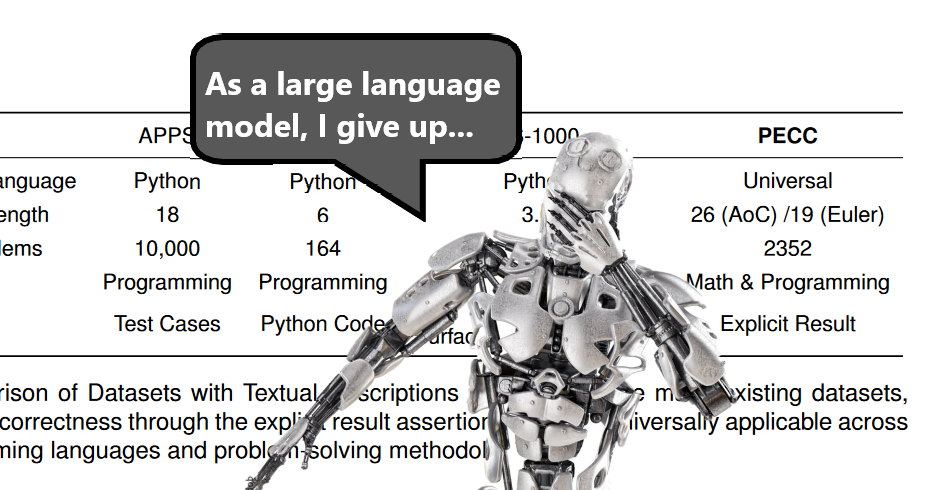

Pero que den siempre la razón —salvo en esas excepciones— no es el mayor de los problemas. Es un hecho bien sabido que los modelos pueden, y lo hacen con frecuencia, «alucinar» información, presentando hechos, citas o estadísticas falsas con total seguridad. Estudios indican que incluso modelos avanzados como GPT-4.5 pueden alucinar entre un 15 % y un 30 % de las veces en tareas que requieren citas precisas. En algunos casos, como en Grok (el de Twitter), los errores en tareas factuales pueden superar el 50 %. Es decir, que tirando una moneda a cara o cruz tienes más probabilidad de acertar. Estos errores pueden tener efectos catastróficos en quienes confíen en los modelos.

Pero claro. Un sistema de IAG no puede ser responsable de sus errores. La culpa por difamación, publicidad engañosa, información médica incorrecta o por un consejo legal inapropiado recae íntegramente en los humanos y en las empresas que lo publican. La ignorancia no ofrece protección legal y los tribunales no aceptan un «lo hizo la IA» como defensa.

Todo esto me lleva al meollo de la cuestión…

Deja una respuesta